面向信任的人机协同搜救方法研究

1. 研究背景

1.1 人机协同搜救

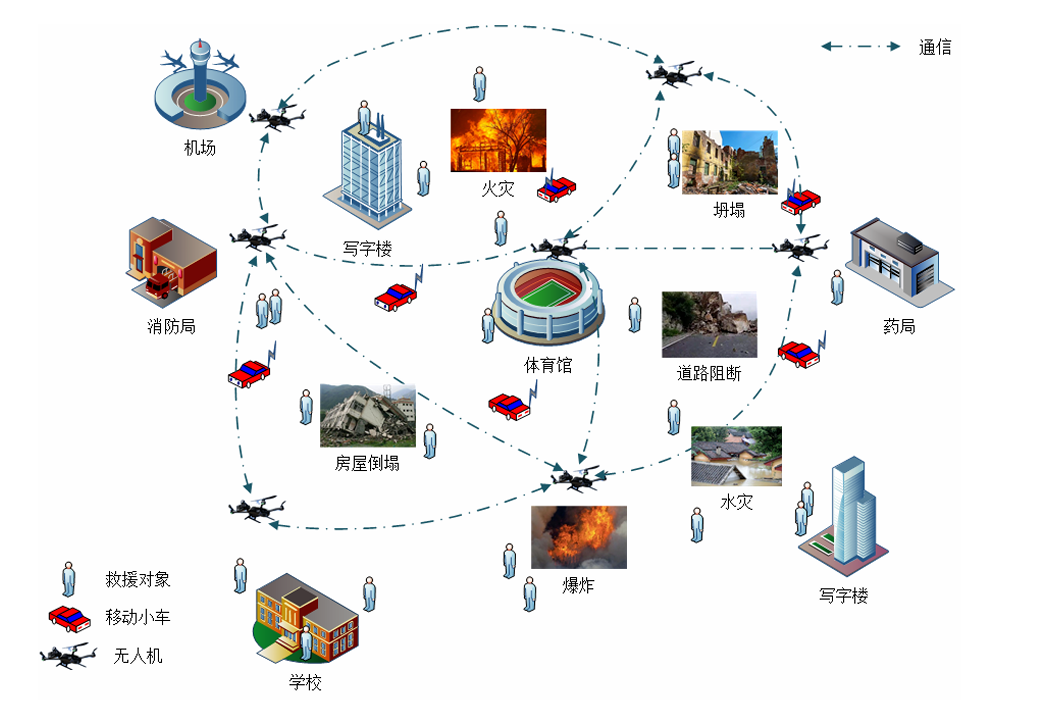

在应急搜救领域,人机协同搜救中的自主技术已经取得了显著的进展。随着国家工业化和智能化的发展,无人机等自主智能装备为应急搜救提供了全新的手段,并在实际应用中取得了很好的效果(missing reference)。如通过深度学习和计算机视觉等技术,无人机可以实时识别和分类灾害现场的各种目标,如受困人员、火源位置和受损建筑等。在地震救援中,AI赋能的无人机能够自主扫描受灾区域,快速识别废墟下的生命迹象,极大地提高了救援效率和准确性(missing reference)。

图1 搜救场景示意图

尽管AI赋能的无人机展现了巨大潜力,但其在实际应用中也带来了一些新的问题:

- 复杂环境适应性:灾害环境通常复杂多变,现有的AI算法虽然能实现较强的判断推理能力,但在动态、实时的要求下存在本质限制,无法有效处理救援场景中的动态目标和突发情境。

- 算法不可解释性:深度学习算法缺乏可解释性,使得非专业背景的救援人员难以理解无人机的飞行决策过程,无法完成有效的人机协作。

因此,为了有效解决上述问题对人机协同搜救的影响,亟需提出一种新的方法来改善人机协作。

1.2 人机协同中的信任机制

人机信任作为人对机器客观能力的主观认知,代表了人在当前时刻对机器能力的判断。合适的信任能够作为对机器能力的评估在人机协同搜救中起着至关重要的作用:

- 动态调整控制权:人机信任机制可以根据信任动态调整人类操作员与机器之间的控制权分配以应对复杂环境。在高信任水平下,系统可以赋予机器更大的自主权,使其在简单环境中自主执行任务;而在低信任水平下,则可以通过增加人工干预的比例来保证复杂环境下任务的安全性和准确性。

- 提高任务完成效率:合理的人机信任机制能够促进信息的有效传递和共享,减少不必要的重复工作和误判。例如,在多无人机协同作业中,通过信任机制协调各个单元之间的任务分配,可以避免资源浪费,提高整体任务完成效率。

- 优化交互界面信息:在人机交互界面上合理的披露与机器感知、规划、决策等相关信息能够帮助人更好的理解无人机的飞行过程,从而保证人对机器有着合适的信任值,不至于产生过度或缺乏信任的问题。

因此,在人机协同搜救中构建合适的信任机制是有必要的。

2. 研究现状

2.1 信任模型

根据定量信任模型中是否出现过往信任(即历史时刻的信任水平),可将信任模型分成两类:无过往信任模型和有过往信任模型。有过往信任模型根据数学形式又可分为两类:有过往信任时间序列模型和有过往任概率图模型。无过往信任模型研究不多,该模型是指信任模型中只有当前时刻信任和机器决策历史中影响信任的相关因素,适用于人机关系简单、影响因素较少的情形。如Wang等(missing reference)针对人和机械臂协作的场景,考虑机器对于人类的信任,把人类表现作为影响信任的唯一因素,最终将信任建立为安全性、机器人奇点、运动的平滑性以及人类的身体和认知表现的加权和。有过往信任时间序列模型(missing reference)是现有研究最多的模型,该模型考虑信任的变化惯性,即当前时刻信任不仅和机器性能、任务环境等因素相关,还和过往时刻的信任有关,最终构建为时序模型。如Hu等(missing reference)提出了一个针对人机协作场景下的通用信任模型。他们以机器漏报率和错报率作为机器的性能表现,并且把累积信任和人的期望偏置引入到信任模型中,给出了信任演化模型的稳定性条件。然而,现有模型大多考虑某些信任影响因素并将其放入某个数学模型中,对模型中的参数意义没有分析,使得信任模型缺乏原理上的解释,难以用于后续控制优化设计。

2.2 人机协作中的信任应用

现有信任研究中利用人机信任对人机协同中人和机器的权限进行划分或对机器难以刻画的性能进行估计较少。核心在于人机信任研究大多还处于信任的定性定量分析阶段,针对控制场景下的信任模型并不多。少数相关性研究采用以性能为中心的代数模型,将人的控制舒适度、对机器决策的顺从性等因素考虑在内,并采用人对机器的信任作为机器的自主性水平考虑到人机共享控制的仲裁中(missing reference)。但针对的场景与人机协同搜救相似性不大,难以迁移使用,且对信任在仲裁中的设计缺乏解释性。对于单人多机的救援场景中,人机信任被进一步简化,大多直接采用人机交互界面或在控制端设置额外的按键用以回报对不同机器的信任程度,并将其用于多机编队控制或风险控制中(missing reference)。

3.研究意义

因此,本课题的研究不仅将推动信任建模技术的发展,开发出应用于应急搜救领域的更加精确可靠的信任模型,还对人机协作中的信任应用进行拓展,推动人机信任研究走向实用化。从社会价值的角度来看,通过构建和完善人机信任机制,可以提高应急搜救的成功率,减少灾害造成的人员伤亡,这对于保障人民生命安全具有重要意义,值得深入研究。